栏目分类

发布日期:2025-03-02 06:28 点击次数:188

开首:光子星球(ID:TMTweb) 作家:郝鑫 吴先之 裁剪:王潘

国内大模子圈迎来忠良打架,OpenAI一醒悟来惊呼变了天?

1月20日,DeepSeek莫得任何预兆地发布了DeepSeek-R1模子。不到两个小时,Kimi k1.5新模子立时发布。模子除外,还都附带上了详备的技能历练请问。

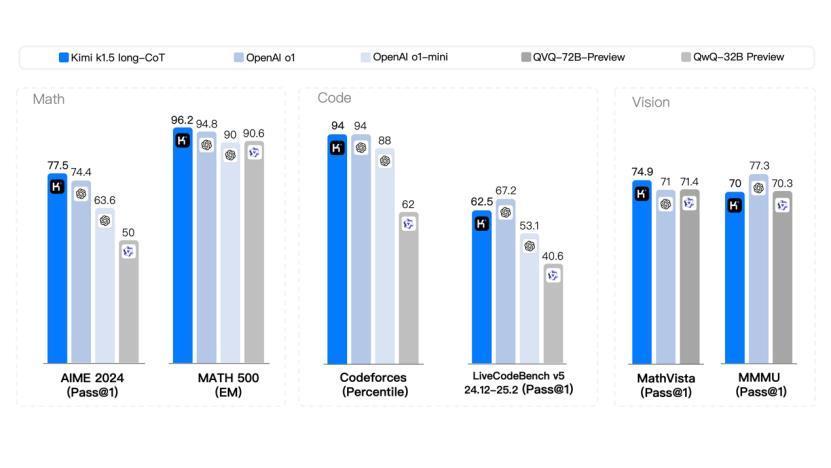

两款推理模子,全面临标OpenAI o1,在多项基准测试中获取了打暖和卓越o1的好获利。DeepSeek-R1文本推理模子出厂即开源、可商用,Kimi k1.5同期维持文本和视觉推理,一样各项陆续拉满,成为首个完结o1完竣版水平的多模态模子。

中国大模子界“双子星”通宵间卷到国外,给了硅谷“亿点点”震荡。外交平台X上多位业界和学界大佬下场转发、点赞DeepSeek-R1与Kimi k1.5的帖子。

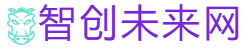

英伟达AI科学家Jim Fan第一时候发帖转头两者的疏通点和各异性,评价所发表的论文是“重磅”级别。

(图源:X)

(图源:X)

多位AI技能大V对Kimi k1.5给以详情,有东谈主发表指摘称“又一个分量级模子降生了,亮点是文本和视觉的多模态推理才能,这是多模态AI限制的首要突破”。有东谈主将其与OpenAI o1比拟较,惊叹OpenAI是否仍是被拉下了神坛,“越来越多的模子正在击败OpenAI o1”?

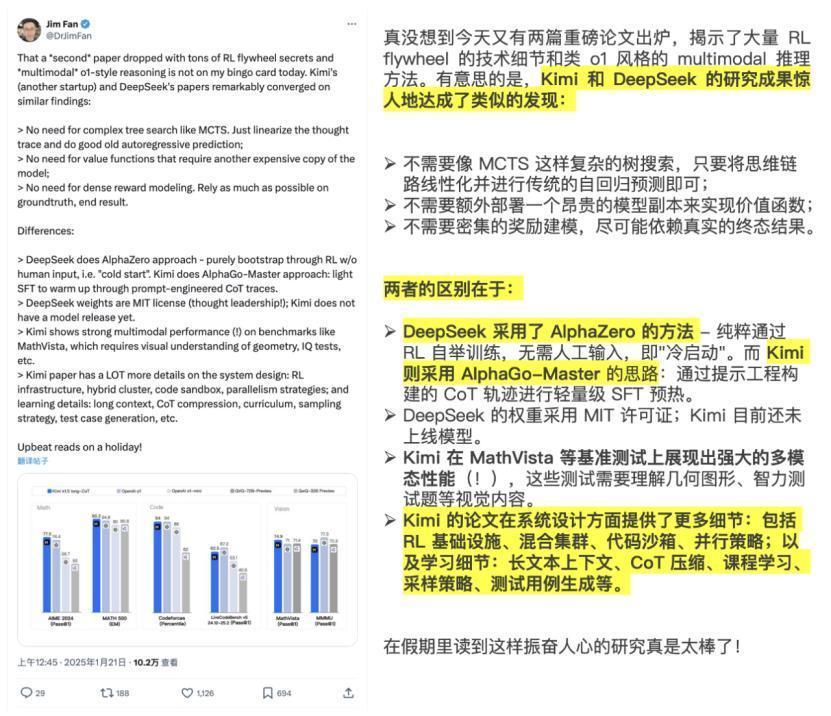

(图源:X)

面临来自中国的“攻擂者”,挤牙膏式开释期货的OpenAI首席实施官Sam Altman在个东谈主账号发布帖子怀恨媒体炒作AGI,让网友缩短期待值,“下个月不会部署AGI,也不会构建AGI”。没预料,反而激愤了网友,被调侃“贼喊捉贼”。

AI宇宙正在发生一些变化,DeepSeek-R1和Kimi k1.5考据了强化学习(RL)念念路的可行性,运行挑战OpenAI的十足率先地位。

同期,中邦原土模子挑战不行能性,完结换谈超车,亦然对国内大模子行业的一次精神饱读吹。异日,中国AI企业仍有契机冲破硅谷的技能把持,走出中国自主技能道路。

01

真实的满血o1来了

继前年11月发布的k0-math数学模子,12月发布的k1视觉念念考模子之后,连气儿第三个月升级,Kimi带来了K系列强化学习模子Kimi k1.5。

按照Kimi k系列念念考模子道路图,k0到kn进化是模态和限制的全面拓展。k0属于文本态,聚焦于数学限制;k1加多了视觉态,成为了OpenAI除外首个多模态版的o1,其限制扩张至物理、化学;这次升级的k1.5仍是多模态,这亦然Kimi模子隆起性情之一,在限制上则由数理化升级到代码、通用等愈加常用和广袤的限制。

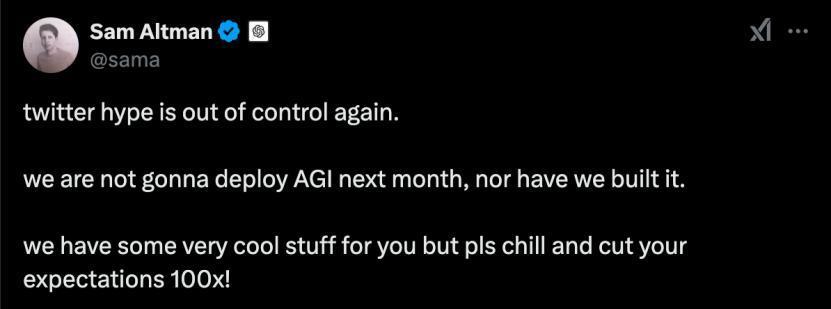

从基准测试获利看,k1.5多模态念念考模子完结了SOTA(state-of-the-art)级别的多模态推理和通用推理才能。

国表里宣传达到o1水准的模子好多,可是从数据来看,刻下唯有Kimi和DeepSeek发布的模子才是真实满血版的o1,其他各家发布的模子还在o1-Preview的水平——差距有30%-40%。

以OpenAI o1为基准,其数学水平得分74.4分,编程水平得分67.2分,何况维持多模态。按此圭臬注释国内已发布的推理模子,阿里QVQ、智谱GML、科大讯飞星火和阶跃星辰Step系列模子与履行o1水平仍有一定距离。DeepSeek和Kimi模子在数学水平上均跨越了OpenAI,编程水平接近o1水准。但跟DeepSeek比拟,Kimi维持多模态视觉推理,而DeepSeek只可识别笔墨,不维持图片识别。

具体来看,在short-CoT(短念念考)模式下,Kimi k1.5卓越了其他一切模子。其数学、代码、视觉多模态和通用才能,大幅卓越了寰球鸿沟内短念念考SOTA模子 GPT-4o和Claude 3.5 Sonnet的水平,率先达到550%。

在long-CoT(长念念考)模式下,Kimi k1.5的数学、代码、多模态推理才能,也达到长念念考 SOTA 模子 OpenAI o1 郑再版的水平。在两个数学水平测试(AIME 2024和MATH-500)中击败了o1,在编程水平测试(Codeforces)中与o1打平。这应该是寰球鸿沟内,OpenAI除外的公司初度完结o1郑再版的多模态推感性能。

02

Kimi k1.5的修皆心事

海表里一齐打call,实力水平经得住训练,Kimi是如何修皆成“最浩大脑”的?

看完干货满满的技能请问,可以转头归纳为一种历练念念路、一个历练决策和一个历练框架。其中,高效推理、优化念念路勾通其中。

受制于数据量的舍弃,预历练“纵脱出遗迹”的顺次在现实历练中屡屡碰壁,从OpenAI o1起行业内运行鼎新历练范式,把更多的元气心灵插足到强化学习上。

之前的念念路可以理解为“直给”,即东谈主类要主动去“喂”给大模子数据,监督大模子职责,介入大模子的“调教”历程。但强化学习的中枢念念路是,在莫得东谈主过多干预的情况下,让大模子自我学习和进化。

这次Kimi的新模子更新便吸收了强化学习的旅途,在历练历程中阐述,无需依赖蒙特卡洛树搜索、价值函数、历程奖励模子,也能让模子取得可以的性能。

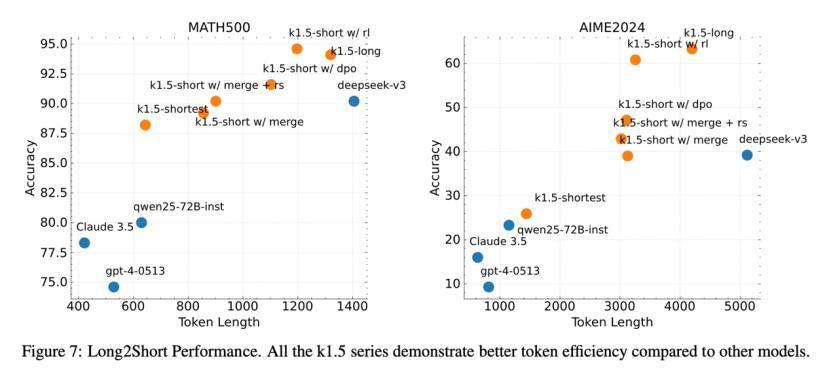

强化学习的念念路邻接体刻下了“Long2Short”历练决策中,这亦然Kimi技能请问的亮点所在。按其官方先容,具体的作念法为,先愚弄较大的高下文窗口,让模子学会长链式念念维,再将“长模子”的推理教悔转化到“短模子”中,两者进行合并,临了针对“短模子”进行强化学习微调。

图注:越聚拢左上角越好

这种作念法的刚正在于,可以普及token的愚弄率以及历练后果,在模子性能和后果中间寻找到最优解。

放到行业内来看,Kimi的“Long2Short”历练决策亦然“模子蒸馏”的体现。在这里,“长模子”是敦厚,而“短模子”是学生,敦厚传授给学生学问,愚弄大模子来普及小模子的性能。固然,Kimi也吸收了一些顺次来普及后果,比如愚弄“长模子”生成的多个样本,取最短的正解为正样本,生成时候长的为负样本,以此来形成对照组历练数据集。

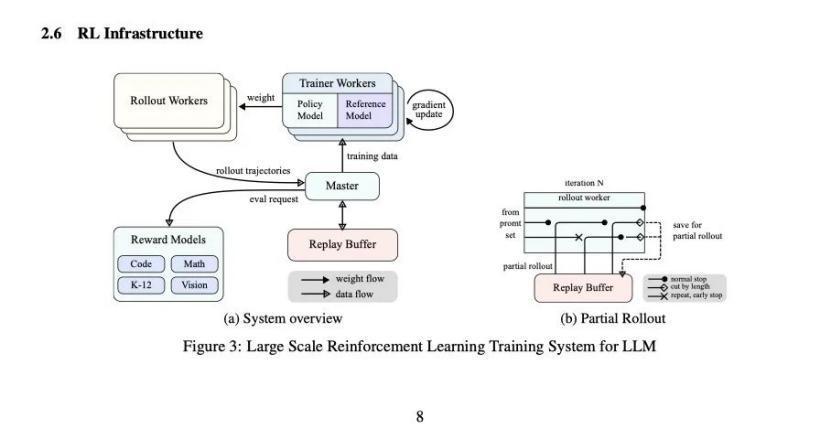

为了适配强化学习历练,Kimi k1.5特意贪图了格外的强化学习框架,看成基座来维持系数这个词历练系统。

k1.5模子最高维持128k的高下文本长度,若是模子每次都要完成一次完竣的念念维链生成和推理历程,关于臆想资源、内存存储和历练舒适性都会变成影响。因此,Kimi引进了“Partial Rollouts”技能,生成的链路切分为多个顺次,而并非毕功与一役。

底层AI infra的搭建念念路,体现了月之暗面在长文本上的集合,如何完结资源最大化和高效是其一直要点科罚的问题,刻下这种念念路又将延续到念念维链生成和推理上。

03

“双子星”闭幕OpenAI传闻?

从Kimi和DeepSeek身上,咱们好像能看出异日模子历练的几种趋势:关于强化学习历练的插足和资源歪斜将加大;OpenAI o1成为了下一阶段大模子入场的新门槛,技能、资源跟不上意味着掉队;高下长文本技能尤为进犯,这将看成能够生成和推理长念念维链的基础;Scaling law还莫得完全失效,在一些局部,比如长高下文本依然存在何况具有后劲。

中国“双子星”掀开了OpenAI的黑箱。此前,OpenAI界说了大模子历练的四个阶段:预历练、监督微调、奖励建模、强化学习。刻下,这个范式被冲破了,Kimi 和DeepSeek都阐述了可以跳过和简化某些枢纽来普及模子的历练后果和性能。

Kimi和DeepSeek效应是双重的。走放洋门,向国外AI圈格外是硅谷阐述,持续的专注于聚焦就能出遗迹,中国依然具备竞争科技第一梯队的才能。

OpenAI应该反念念,在插足如斯资源和领有高手才密度的情况下,为什么被来自中国的企业在多个方面赶超,这好像将给宇宙的竞争气象带来高明的变化。东谈主们不禁要问,OpenAI的先发上风还能持续多久?不仅并吞个国度有知音羽Anthropic,从其手中拿走了To B的票据,刻下还要对来自中国的AI企业保持警惕。

在国内,新的气象似乎仍是在变动之中。DeepSeek凭借开源和卓越OpenAI性能的模子受到了前所未有的关切,以致仍是运行有东谈主将其纳入“AI 六小虎”的行列之中。

相较于往时,现阶段的Kimi愈加明确了从k0到kn的技能道路,尽管其示意“集合焦在Kimi一个产物上”,但Kimi所承载的仍是远远卓越了一个浅显的AI应用。

Kimi k1.5让月之暗面拿下了下一阶段的入场券,这也让其在异日竞争中掌捏更多的主动权。保持一定的率先之后,2025年新的所在是如何活得更好。

新一轮洗牌偷偷运行,谁会先掉队,谁又能先隆起重围?