栏目分类

发布日期:2024-12-07 07:14 点击次数:190

李川皓 投稿

量子位 | 公众号 QbitAI

一个5月份完成考试的大模子,无法对《黑传说·悟空》游戏内容有关问题给出准确回复。

这是大模子的老过失了。

因为《黑传说》8月才上市,考试数据里莫得它的有关知识。

家喻户晓,大模子的考试和微调会浪费多半筹划资源和时分,这意味着庸碌更新大模子的参数是不切本色的。

干系词,履行天下中的信息是及时产生的且不停变化的。这使得大模子在完成考试后,关于后续新产生的信息感到目生,是以无法提供准确可靠的反应。

为此,上海东谈主工智能实验室、北京理工大学、浙江大学、香港大学辘集漠视即插即用的SearchLVLMs框架,不错无缝整合纵情的多模态大模子。

该框架在推理阶段对大模子进行互联网检索增强,使得大模子无需微调即可对及时信息进行准确的反应。

照拂团队漠视首个扶植多模态大模子对及时信息进行反应的开源检索增强框架SearchLVLMs。

该框架主要包括查询生成、搜索引擎调用、分层过滤三个部分。

以视觉问答为例,该框架会基于问题和图片生成查询关键词,并调用搜索引擎查找有关信息,再由粗到细地对检索抑遏进行过滤,得到对回复该问题有匡助的信息。

这些信息会以prompt的形势在推理阶段提供给模子,以扶植回复。

同期,团队漠视一个数据生成框架UDK-VQA,它不错自动生成依赖及时信息进行回复的视觉问答数据。

基于此框架,数据集不错完成动态更新,以保证测试数据的时效性。

当今已有UDK-VQA-240401-30、UDK-VQA-240816-20两个版块的数据集,波及到的时分跨度差别是2024年4月1日-2024年4月31日和2024年8月16日-2024年9月5日。

照拂者在跳动15个开源、闭源模子上进行了实验,包括GPT-4o、Gemini 1.5 Pro、InternVL-1.5、LLaVA-1.6等。

在UDK-VQA数据集上的回复准确率,则配备了SearchLVLMs的SOTA LVLMs跳动了自带互联网检索增强的GPT-4o模子35%。

开源框架SearchLVLMs

SearchLVLMs框架主要由三部分构成:

查询生成搜索引擎调用分层过滤在查询生成阶段,需要对问题和图像进行充分地雄厚,以滚动为适用于搜索引擎的文本查询。

关于问题而言,奏凯使用手工瞎想的prompt调用LLM得到问题查询词。

关于图像而言,调用必应视觉搜索得到包含该图像或与该图像有关的网页,索要这些网页的题目/快照的最长寰球子串算作图像查询词。

在搜索引擎调用阶段,用户不错笔据问题类型自主选拔调用的搜索引擎类别。

比如:关于及时性较强的新闻有关问题,不错选拔调用必应新闻搜索;关于知识性问题,不错选拔调用必应通用搜索。

调用搜索引擎后会得到多个网页的题目、选录和一语气。

在分层过滤阶段,起初调用网页过滤器对得到的网页进行初筛,基于网页的题目和选录对这些网页进行重排。

关于排序靠前的网页,使用爬虫取得网页的文本内容,每三句切分红一个片断,使用内容过滤器对这些片断进行重排。

关于排序靠前的片断,基于CLIP特征对它们进行聚类,选拔离每个聚类中心的最近的片断,以幸免内容商量片断对大模子估计带来的误导。

被选拔的片断被奏凯拼接在一谈,用于指示大模子。

其中,网页过滤器和内容过滤器是两个沉寂考试的LLaVA-1.5模子,作用是为网页/片断进行打分——网页/片断关于回复该问题的匡助进程。

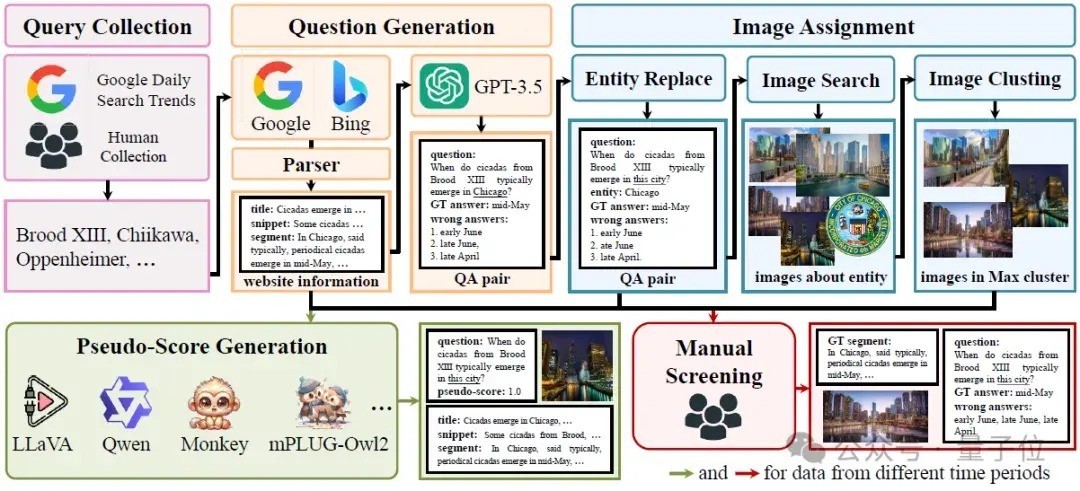

为了考试这两个过滤器,也为了测试大模子对及时信息的反应智力,照拂团队进一步漠视了一个数据生成框架——UDK-VQA,如下图所示。

五个才略完成数据生成

UDK-VQA数据生成主要罢黜五个才略:

差别是查询征集、问题生成、图像分拨、伪标注生成、东谈主为考据。

第一步,查询征集。

查询征集主要包括两方面,一方面是从谷歌逐日搜索趋势上爬取热点搜索词,另一方面是东谈主为征集一些热点搜索词来对前者进行补充。

第二步,问题生成。

照拂东谈主员起初笔据征集到的搜索词调用搜索引擎得到有关的新闻,将新闻内容进行切分,得到多个内容片断。

然后条目GPT笔据内容片断自问自答,得到<问题,谜底>的汇集。

在第三步图像分拨阶段,团队会索要出问题中的实体,使用图片搜索引擎得到实体的图片,并将问题中的实体单词替换为其上分位词,与图片一谈构成视觉问答样本。

第四步,伪标注生成。

为了考试网页过滤器和内容过滤器,需要对网页/片断进行打分。

关于一个视觉问答样本和一个网页/片断,照拂者基于两个原则进行打分:

① 若是该样本是基于该网页/片断生成的,分数为1.0。

② 若是该样本不是基于该网页/片断生成的,使用5个开源模子在该网页/片断下尝试回复该样本,笔据模子回复的正确率进行打分。

基于这么的伪标注活动,照拂东谈主员构造了~80w样本用于考试。

终末一步,东谈主为考据。

构造测试集时,照拂者对第3步得到的视觉问答样本进行了东谈主为筛选,确保测试样本的正确性。

为了幸免考试数据和测试数据需要参考同样的及时信息,在构造考试集和测试集时,照拂历程中使用不同技艺区间的谷歌逐日搜索趋势来爬取热点搜索词。

下图中(a)、(b)、(c)差别展示了考试样本、测试样本和测试样本的散布。

基于数据生成框架UDK-VQA,很容易不错构造出需要及时信息进行回复的视觉问答样本。

照拂团队声明会不停更新测试集,保证测试样本的时效性。

当今,照拂东谈主员还是构造了两个版块的测试集,差别波及到2024年5月份和2024年9月份的信息。

实验抑遏与论断SearchLVLMs框架团队在UDK-VQA上测试了15个现存的LVLMs,主要实验抑遏如下表所示。

其中,Raw暗示模子的原始版块(莫得检索增强功能)、Long-Context (LC)暗示将搜索引擎复返的网页爬取内容后,奏凯拼接起来指示模子,IAG暗示使用了模子内嵌的互联网检索增强智力。

Gen.、Cham.和CLIP→FID (C→F)差别暗示[1]、[2]和[3]中的活动。

从实验抑遏中不错有以下发现:

1、接纳长落魄文输入不错一定进程上幸免对搜索引擎的复返内容进行二次筛选。

Gemini Pro 1.5 (LC)的性能高于内嵌互联网检索增强的GPT-4V和GPT-4o,然而长落魄文会引入特等的筹划浪费,并引入一些无须要的信息对模子形成误导。

经过SearchLVLMs的分层过滤模子进行二次筛选还有,不错进一步进步模子性能。

2、具备检索增强智力的闭源商用模子在性能上显赫高于不具备检索增强智力的开源模子。

GPT-4V和GPT-4o由于内嵌互联网检索增强模块,在准确率上大幅当先开源模子,如LLaVA-1.6和InternVL-1.5,差距约为20%~30%。

3、SearchLVLMs框架不错整合纵情的多模态大模子,并大幅度提高它们关于依赖及时信息的问题的回复智力。

不管是在闭源商用模子Gemini 1.5 Pro、GPT-4o、GPT-4V,照旧开源SOTA模子LLaVA-1.6和InternVL-1.5上,SearchLVLMs均能带来跳动50%的性能进步。

4、SearchLVLMs带来的性能进步,远高于已有活动。

照拂对比了检索增强活动Gen.、C→F和调用搜索引擎来扶植回复的框架Cham.,SearchLVLMs在粗莽及时信息检索任务时,证明出明显的优厚性。

5、使用SearchLVLMs整合开源模子,性能不错大幅跳动内嵌互联网检索增强智力的闭源商用模子。

InternVL-1.5+SearchLVLMs的准确率为92.9%,远高于GPT-4o(IAG)的57.8%。

这一发现标明,开源模子具有庞大的后劲,SearchLVLMs在性能、可定制性和透明度上具有显赫的上风。

参考文件[1] Yu et al. Generate rather than retrieve: Large language models are strong context generators. arXiv 2023.

[2] Lu et al. Chameleon: Plug-and-play compositional reasoning with large language models. NeurIPS 2023.[3] Chen et al. Can pre-trained vision and language models answer visual information-seeking questions? EMNLP 2023.著作一语气: https://arxiv.org/abs/2405.14554

步田主页:https://nevermorelch.github.io/SearchLVLMs.github.io/

— 完 —

量子位 QbitAI · 头条号签

心思咱们,第一时分获知前沿科技动态约